Vous souhaitez partager votre contenu sur R-bloggers ? cliquez ici si vous avez un blog, ou ici si vous n’en avez pas.

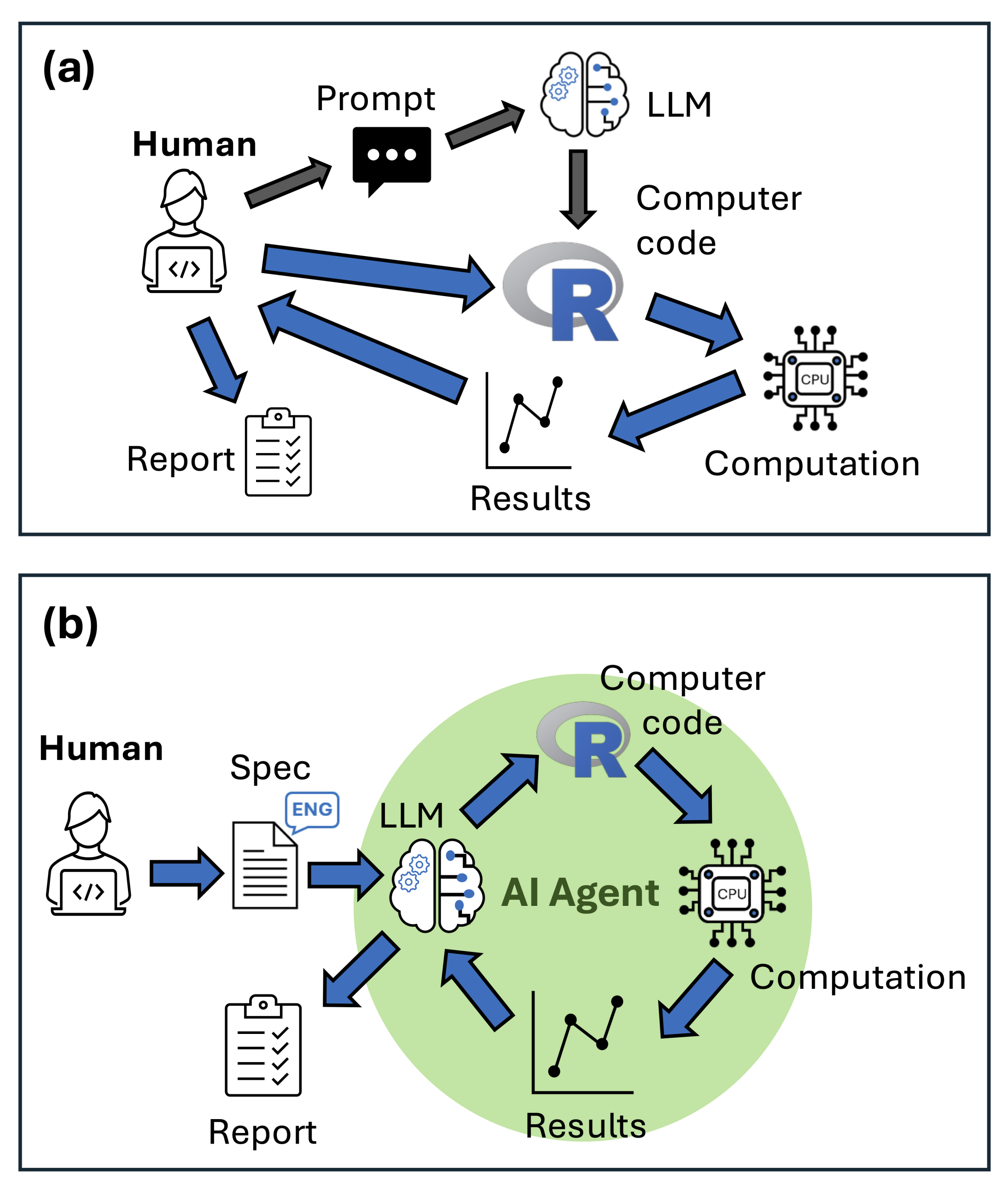

Les outils d’IA agentique comme Claude Code peuvent écrire et exécuter du code, corriger ses propres erreurs et produire un rapport formaté avec des chiffres. Je voulais savoir si cela se traduisait par une modélisation écologique fiable, nous avons donc effectué un test : trois tâches de pêche, quatre modèles d’IA, dix exécutions indépendantes chacune, notées selon une rubrique. Les résultats sont publiés dans Fish and Fisheries.

Nous avons constaté que les agents peuvent être véritablement utiles, mais seulement si vous savez comment bien les utiliser et seulement si vous en savez suffisamment sur l’analyse pour détecter ce qu’ils manquent.

Comment nous avons effectué nos tests

Nous avons utilisé Roo Code, une IA agentique qui s’exécute dans VS Code. Contrairement à un chatbot, il peut écrire du code, l’exécuter, lire les messages d’erreur et itérer de manière autonome. Il existe de nombreux logiciels populaires pour l’IA agentique, Claude Code est actuellement le plus populaire. Nous avons choisi Roo Code car il est open source et entièrement personnalisable.

Nous lui avons remis des fiches techniques détaillées et lui avons demandé de réaliser trois tâches. L’une d’entre elles était une tâche courante de modélisation écologique : l’ajustement d’un modèle linéaire généralisé (GLM) de l’abondance des poissons et de l’habitat des coraux. Les deux autres tâches étaient spécialisées dans la modélisation des pêcheries : ajuster une courbe de croissance de von Bertalanffy et effectuer une analyse du rendement par recrue. Nous les avons choisis parce qu’ils sont courants dans les sciences écologiques, mais suffisamment spécialisés pour que les LLM n’aient probablement pas vu beaucoup d’exemples dans leurs données de formation.

Nous avons exécuté chaque tâche 10 fois. Les réponses LLM ont un certain caractère aléatoire, et cela se multiplie lors de tâches de longue durée. La cohérence est donc aussi importante à mesurer que la meilleure performance. Nous avons noté chaque résultat selon une rubrique couvrant l’exactitude, la qualité du code et la qualité des rapports.

Nous avons utilisé quatre versions de LLM. Deux modèles propriétaires : Claude Sonnet 4.0, Sonnet 4.5 (sorti lors de la révision donc nous l’avons ajouté plus tard). Un modèle à poids ouvert : Kimi K2 et sa variante « exacto ».

Lors de l’examen, Kimi K2 « exacto » est devenu disponible sur la plate-forme OpenRouter, nous l’avons donc ajouté. L’exacto achemine les demandes vers les fournisseurs les plus performants. Certains fournisseurs le proposent à moindre coût. Pour faire court, exacto a bien mieux fonctionné que de simplement demander la version K2 de n’importe quel fournisseur, cela souligne l’importance d’exécuter des modèles à poids ouvert sur du matériel de qualité.

Comment utiliser l’IA agentique pour la modélisation écologique

Nous avons tiré plusieurs enseignements clés sur la manière de tirer le meilleur parti de l’IA agentique pour la modélisation écologique.

Rédiger une fiche technique détaillée. Nos fiches comportaient plusieurs pages couvrant les objectifs de l’analyse, la structure des données, les fonctions et packages R recommandés, les résultats attendus et les conventions de dénomination des fichiers. Cela prend du temps, mais rédiger un cahier des charges vous oblige à bien réfléchir à ce que vous voulez réellement. Voici un exemple.

Spécifiez explicitement les algorithmes. Les agents utilisent par défaut la méthode la plus courante dans leurs données de formation, ce qui peut ne pas convenir à votre question. Si vous souhaitez des intervalles de confiance bootstrapés via le boot paquet, dis-le.

Même dans ce cas, ils pourraient ne pas s’y conformer : les deux modèles de Claude de notre étude ont appliqué à plusieurs reprises la mortalité naturelle à la première classe d’âge dans le modèle de rendement par recrue, malgré les instructions explicites de ne pas le faire. Il s’agit d’une erreur subtile qui a affecté les estimations des captures, les chiffres qui éclaireraient la gestion de la pêche. Ces bizarreries du comportement des agents soulignent pourquoi la supervision d’experts est essentielle.

Exécutez des répliques et comparez les sorties. Les scores de précision variaient considérablement d’une exécution à l’autre. parfois, l’agent a défini chaque paramètre ; parfois, certaines parties étaient correctes, mais des erreurs systématiques étaient commises dans d’autres parties de l’analyse. Exécuter plusieurs agents et comparer les résultats est un moyen d’identifier les meilleures solutions.

Vérifiez les choses que l’agent ne sait pas vérifier. Aucun de nos agents n’a vérifié la colinéarité entre les prédicteurs dans le GLM, même si c’est une pratique courante. Nous l’avons délibérément laissé en dehors des spécifications pour voir s’ils le feraient. Les GLM ont bien fonctionné, les résultats semblaient cohérents, mais il y avait en fait une forte colinéarité entre les prédicteurs. La leçon à retenir ici est que les agents sont bons en codage, mais que leur mise en œuvre conceptuelle peut être trompeuse, incomplète ou logiquement erronée.

Le plus gros problème de l’IA agentique est qu’elle peut produire une sortie formatée de manière professionnelle contenant des erreurs logiques.

Le type d’erreur qui me préoccupe le plus est une sortie formatée professionnellement contenant des erreurs logiques.

Dans nos résultats, nous avons vu des courbes de croissance très bien tracées mais utilisant la mauvaise méthode d’intervalle de confiance, ou une analyse de rendement qui applique la mortalité dans le mauvais ordre. Une erreur de syntaxe de codage est immédiatement évidente. Un raccourci méthodologique intégré dans une sortie par ailleurs propre peut être invisible à moins que vous ne sachiez déjà à quoi devrait ressembler la réponse.

Il existe un risque réel que des chercheurs inexpérimentés utilisent ces outils pour produire des analyses qu’ils ne peuvent pas évaluer. Les chercheurs expérimentés peuvent également devenir trop confiants et ne pas vérifier les résultats de manière suffisamment approfondie. Ces failles peuvent ensuite se répercuter sur les applications, comme nous l’avons vu lorsque les erreurs humaines dans la modélisation écologique ont un impact sur les décisions concernant les espèces envahissantes.

Pour les scientifiques disposant de bases quantitatives solides, les agents offrent un réel gain d’efficacité. Les fiches techniques et les rubriques de notre étude sont dans les supports complémentaires si vous souhaitez les adapter. Tout notre code est disponible sur github si vous souhaitez exécuter vos propres tests (Vérifiez ce dossier, chaque ‘test-case’ de modélisation contient la fiche technique et d’autres fichiers)

L’article est en libre accès : Brown et al. 2026, Poissons et pêcheries.

En rapport

PakarPBN

A Private Blog Network (PBN) is a collection of websites that are controlled by a single individual or organization and used primarily to build backlinks to a “money site” in order to influence its ranking in search engines such as Google. The core idea behind a PBN is based on the importance of backlinks in Google’s ranking algorithm. Since Google views backlinks as signals of authority and trust, some website owners attempt to artificially create these signals through a controlled network of sites.

In a typical PBN setup, the owner acquires expired or aged domains that already have existing authority, backlinks, and history. These domains are rebuilt with new content and hosted separately, often using different IP addresses, hosting providers, themes, and ownership details to make them appear unrelated. Within the content published on these sites, links are strategically placed that point to the main website the owner wants to rank higher. By doing this, the owner attempts to pass link equity (also known as “link juice”) from the PBN sites to the target website.

The purpose of a PBN is to give the impression that the target website is naturally earning links from multiple independent sources. If done effectively, this can temporarily improve keyword rankings, increase organic visibility, and drive more traffic from search results.